Бұл мақалада біз robots.txt файлының веб-сайттардағы трафикті басқарудағы негізгі рөлін қарастырамыз, оның болуының қажеттілігін талқылаймыз және бетті индекстеуді тиімді басқару үшін оны орнату бойынша ұсыныстар береміз. Сонымен қатар, біз robots.txt файлында директиваларды дұрыс пайдалану мысалдарын талдаймыз және оның параметрлерінің дұрыстығын тексеру әдісі бойынша нұсқаулықты береміз.

Robots.txt не үшін қажет

Robots.txt - бұл сайт серверінде оның түбірлік каталогында орналасқан файл. Ол іздеу жүйесі роботтарына ресурс мазмұнын қалай сканерлеу керектігін хабарлайды. Бұл файлды дұрыс пайдалану қажетсіз беттерді индекстеуді болдырмауға көмектеседі, құпия деректерді қорғайды және SEO оңтайландыруының тиімділігін және іздеу нәтижелерінде сайттың көрінуін жақсартады. robots.txt конфигурациясы директивалар арқылы орындалады, біз оны әрі қарай қарастырамыз.

Robots.txt ішіндегі директиваларды орнату

Пайдаланушы агенті

Негізгі директива User-Agent ретінде белгілі, мұнда біз роботтар үшін арнайы кілт сөзді орнаттық. Бұл сөзді анықтаған кезде робот ереженің арнайы соған арналғанын түсінеді.

Robots.txt файлында User-Agent пайдалану мысалын қарастырыңыз:

User-Agent: *

Disallow: /private/Бұл мысал барлық іздеу роботтарының («таңбасымен көрсетілген») екенін көрсетеді.*") ішінде орналасқан беттерді елемеу керек /жеке/ каталогы.

Нұсқау арнайы іздеу роботтарын қалай іздейді:

User-Agent: Googlebot

Disallow: /admin/

User-Agent: Bingbot

Disallow: /private/Бұл жағдайда Googlebot іздеу роботы беттерді елемеуі керек /admin/ каталог, while Bingbot ішіндегі беттерді елемеу керек /жеке/ каталогы.

Тыйым салу

Тыйым салу іздеу роботтарына веб-сайтта қандай URL мекенжайларын өткізіп жіберу немесе индекстемеу керектігін айтады. Бұл директива құпия деректерді немесе төмен сапалы мазмұн беттерін іздеу жүйелерімен индекстеуден жасырғыңыз келгенде пайдалы. Егер robots.txt файлында жазба болса Рұқсат етпеу: /каталогтар/, содан кейін роботтарға көрсетілген каталогтың мазмұнына кіруге тыйым салынады. Мысалы,

User-agent: *

Disallow: /admin/Бұл мән соны көрсетеді барлық роботтар деп басталатын URL мекенжайларын елемеу керек /admin/. Бүкіл сайтты кез келген роботтар индекстеуге тыйым салу үшін, әдетте, түбірлік каталогты орнатыңыз:

User-agent: *

Disallow: /рұқсат ету

«Рұқсат ету» мәні «Рұқсат етпеуге» қарсы әрекет етеді: ол роботтар.txt файлындағы басқа директивалар оған кіруге тыйым салса да, іздеу роботтарына белгілі бір бетке немесе каталогқа кіруге рұқсат береді.

Мысал қарастырайық:

User-agent: *

Disallow: /admin/

Allow: /admin/login.htmlБұл мысалда роботтарға кіруге рұқсат етілмейтіні көрсетілген /admin/ каталогынан басқа /admin/login.html индекстеу және сканерлеу үшін қол жетімді бет.

Robots.txt және Сайт картасы

Сайт картасы - іздеу жүйелерімен индекстеуге болатын сайттағы барлық беттердің және файлдардың URL мекенжайларының тізімін қамтитын XML файлы. Іздеу роботы robots.txt файлына кіргенде және сайт картасының XML файлына сілтемені көргенде, ол осы файлды сайттағы барлық қолжетімді URL мекенжайлары мен ресурстарды табу үшін пайдалана алады. Директивалар пішімде көрсетілген:

Sitemap: https://yoursite.com/filesitemap.xmlБұл ереже әдетте нақты пайдаланушы-агентке байланыссыз құжаттың соңында орналастырылады және оны барлық роботтар ерекшеліксіз өңдейді. Егер сайт иесі sitemap.xml қолданбаса, ережені қосу қажет емес.

Конфигурацияланған Robots.txt мысалдары

WordPress үшін Robots.txt орнату

Бұл бөлімде біз WordPress үшін дайын конфигурацияны қарастырамыз. Біз құпия деректерге кіруді бұғаттауды және негізгі беттерге кіруге рұқсат беруді қарастырамыз.

Дайын шешім ретінде келесі кодты пайдалануға болады:

User-agent: *

# Block access to files containing confidential data

Disallow: /cgi-bin

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /wp-login.php

Disallow: /wp-register.php

Disallow: /xmlrpc.php

# Allow access to the main site pages

Allow: /wp-content/uploads/

Allow: /sitemap.xml

Allow: /feed/

Allow: /trackback/

Allow: /comments/feed/

Allow: /category/*/*

Allow: /tag/*

# Prohibit the indexing of old versions of posts and parameterized queries to avoid content duplication or suboptimal indexing.

Disallow: /*?*

Disallow: /?s=*

Disallow: /?p=*

Disallow: /?page_id=*

Disallow: /?cat=*

Disallow: /?tag=*

# Include the sitemap (location needs to be replaced with your own)

Sitemap: http://yourdomain.com/sitemap.xmlБарлық директивалар түсініктемелермен бірге болса да, қорытындыларға тереңірек үңілейік.

- Роботтар құпия файлдар мен каталогтарды индекстемейді.

- Бұл ретте роботтарға сайттың негізгі беттері мен ресурстарына кіруге рұқсат етілген.

- Мазмұнның қайталануын болдырмау үшін жазбалардың және параметрленген сұраулардың ескі нұсқаларын индекстеуге тыйым салынады.

- Сайт картасының орны индекстеуді жақсарту үшін көрсетілген.

Осылайша, біз кейбір сезімтал файлдар мен жолдар индекстеуден жасырылған, бірақ негізгі каталогтар қолжетімді болатын дайын конфигурацияның жалпы мысалын қарастырдық.

Көптеген танымал CMS немесе тапсырыс бойынша жазылған сайттардан айырмашылығы, WordPress-те robots.txt файлын жасауды және басқаруды жеңілдететін бірнеше плагиндер бар. Осы мақсатқа арналған танымал шешімдердің бірі Yoast SEO.

Оны орнату үшін сізге қажет:

- WordPress басқару тақтасына өтіңіз.

- «Плагиндер» бөлімінде «Жаңа қосу» тармағын таңдаңыз.

- «Yoast SEO» плагинін тауып, оны орнатыңыз.

- Плагинді іске қосыңыз.

robots.txt файлын өңдеу үшін сізге қажет:

- Әкімші панелінің бүйірлік мәзіріндегі «SEO» бөліміне өтіп, «Жалпы» тармағын таңдаңыз.

- «Құралдар» қойындысына өтіңіз.

- «Файлдар» түймесін басыңыз. Мұнда сіз әртүрлі файлдарды көресіз, соның ішінде robots.txt.

- Сіздің талаптарыңызға сәйкес қажетті индекстеу ережелерін енгізіңіз.

- Файлға өзгертулер енгізгеннен кейін «Өзгерістерді robots.txt файлына сақтау» түймесін басыңыз.

WordPress үшін әрбір robots.txt файл параметрі бірегей және сайттың нақты қажеттіліктері мен мүмкіндіктеріне байланысты екенін ескеріңіз. Ерекшеліксіз барлық ресурстарға сәйкес келетін әмбебап үлгі жоқ. Дегенмен, бұл мысал және плагиндерді пайдалану тапсырманы айтарлықтай жеңілдетуі мүмкін.

Robots.txt файлын қолмен орнату

Сол сияқты, сайт үшін дайын CMS болмаған жағдайда да файлдың конфигурациясын орнатуға болады. Сондай-ақ пайдаланушыға robots.txt файлын сайттың түбірлік каталогына жүктеп салу және қажетті ережелерді көрсету қажет. Міне, барлық қол жетімді директивалар көрсетілген мысалдардың бірі:

User-agent: *

Disallow: /admin/ # Prohibit access to the administrative panel

Disallow: /secret.html # Prohibit access to a specific file

Disallow: /*.pdf$ # Prohibit indexing of certain file types

Disallow: /*?sort= # Prohibit indexing of certain URL parameters

Allow: /public/ # Allow access to public pages

Sitemap: http://yourdomain.com/sitemap.xml # Include the sitemapRobots.txt файлын қалай тексеруге болады

Robots.txt файлында қателерді тексеру кезінде көмекші құрал ретінде онлайн қызметтерді пайдалану ұсынылады.

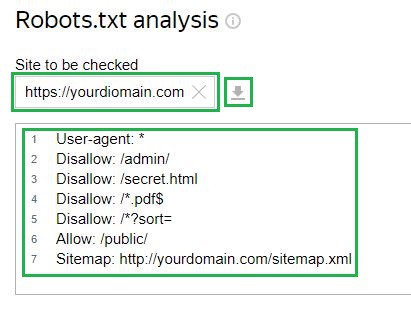

мысалын қарастырайық Яндекс веб-шебері қызмет көрсету. Тексеру үшін файл серверге жүктеп салынған болса, тиісті өріске сайттың сілтемесін енгізу керек. Осыдан кейін құралдың өзі файл конфигурациясын жүктейді. Сондай-ақ конфигурацияны қолмен енгізу мүмкіндігі бар:

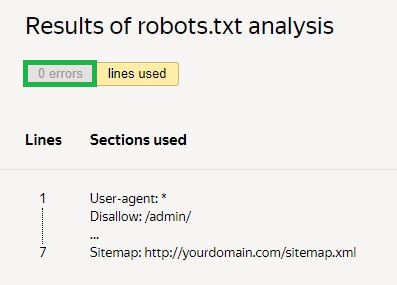

Әрі қарай, сіз тексеруді сұрап, нәтижелерді күтуіңіз керек:

Берілген мысалда қателер жоқ. Егер бар болса, қызмет проблемалық аймақтарды және оларды түзету жолдарын көрсетеді.

қорытынды

Қорытындылай келе, біз robots.txt файлының сайттағы трафикті басқару үшін қаншалықты маңызды екенін атап өттік. Іздеу жүйелерінің беттерді қалай индекстеуін басқару үшін оны қалай дұрыс орнату керектігі туралы кеңес бердік. Бұған қоса, біз бұл файлды қалай дұрыс пайдалану керектігінің мысалдарын қарастырдық және барлық параметрлердің дұрыс жұмыс істеп тұрғанын тексеру туралы нұсқаулар бердік.