În acest articol, vom examina rolul cheie al fișierului robots.txt în gestionarea traficului de pe site-uri web, vom discuta despre necesitatea prezenței acestuia și vom oferi recomandări pentru configurarea acestuia pentru gestionarea eficientă a indexării paginilor. În plus, vom analiza exemple de utilizare corectă a directivelor în fișierul robots.txt și vom oferi un ghid despre cum să verificați corectitudinea setărilor acestuia.

De ce este nevoie de Robots.txt

Robots.txt este un fișier aflat pe serverul site-ului în directorul său rădăcină. Acesta informează roboții motoarelor de căutare cum ar trebui să scaneze conținutul resursei. Utilizarea corectă a acestui fișier ajută la prevenirea indexării paginilor nedorite, protejează datele confidențiale și poate îmbunătăți eficiența optimizării SEO și vizibilitatea site-ului în rezultatele căutării. Configurarea robots.txt se face prin directive, pe care le vom analiza mai departe.

Setarea directivelor în Robots.txt

Agent de utilizator

Directiva principală este cunoscută ca User-Agent, unde setăm un cuvânt cheie special pentru roboți. La detectarea acestui cuvânt, robotul înțelege că regula îi este destinată special.

Luați în considerare un exemplu de utilizare a User-Agent în fișierul robots.txt:

User-Agent: *

Disallow: /private/Acest exemplu indică faptul că toți roboții de căutare (reprezentați prin simbolul "*") ar trebui să ignore paginile situate în /privat/ director.

Iată cum arată instrucțiunea pentru anumiți roboți de căutare:

User-Agent: Googlebot

Disallow: /admin/

User-Agent: Bingbot

Disallow: /private/În acest caz, Googlebot robotul de căutare ar trebui să ignore paginile din /admin/ director, în timp ce Bingbot ar trebui să ignore paginile din /privat/ director.

dezaproba

dezaproba le spune roboților de căutare ce adrese URL să omite sau nu să indexeze pe site. Această directivă este utilă atunci când doriți să ascundeți datele sensibile sau paginile de conținut de calitate scăzută pentru a nu fi indexate de motoarele de căutare. Dacă fișierul robots.txt conține intrarea Nu permiteți: /directories/, atunci roboților li se va refuza accesul la conținutul directorului specificat. De exemplu,

User-agent: *

Disallow: /admin/Această valoare indică faptul că toți roboții ar trebui să ignore adresele URL care încep cu /admin/. Pentru a împiedica indexarea întregului site de către roboți, setați directorul rădăcină ca regulă:

User-agent: *

Disallow: /Permite

Valoarea „Permite” acționează opus cu „Disallow”: permite roboților de căutare accesul la o anumită pagină sau director, chiar dacă alte directive din fișierul robots.txt interzic accesul la acesta.

Luați în considerare un exemplu:

User-agent: *

Disallow: /admin/

Allow: /admin/login.htmlÎn acest exemplu, se specifică faptul că roboților nu li se permite accesul la /admin/ director, cu excepția /admin/login.html pagina, care este disponibilă pentru indexare și scanare.

Robots.txt și Sitemap

Harta site-ului este un fișier XML care conține o listă de adrese URL ale tuturor paginilor și fișierelor de pe site care pot fi indexate de motoarele de căutare. Când un robot de căutare accesează fișierul robots.txt și vede un link către un fișier XML sitemap, poate folosi acest fișier pentru a găsi toate adresele URL și resursele disponibile pe site. Directiva este specificată în formatul:

Sitemap: https://yoursite.com/filesitemap.xmlAceastă regulă este de obicei plasată la sfârșitul documentului fără a fi legată de un anumit User-Agent și este procesată de toți roboții fără excepție. Dacă proprietarul site-ului nu folosește sitemap.xml, nu este necesar să adăugați regula.

Exemple de Robots.txt configurați

Configurarea Robots.txt pentru WordPress

În această secțiune, vom lua în considerare o configurație gata făcută pentru WordPress. Vom explora blocarea accesului la datele confidențiale și permiterea accesului la paginile principale.

Ca o soluție gata, puteți utiliza următorul cod:

User-agent: *

# Block access to files containing confidential data

Disallow: /cgi-bin

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /wp-login.php

Disallow: /wp-register.php

Disallow: /xmlrpc.php

# Allow access to the main site pages

Allow: /wp-content/uploads/

Allow: /sitemap.xml

Allow: /feed/

Allow: /trackback/

Allow: /comments/feed/

Allow: /category/*/*

Allow: /tag/*

# Prohibit the indexing of old versions of posts and parameterized queries to avoid content duplication or suboptimal indexing.

Disallow: /*?*

Disallow: /?s=*

Disallow: /?p=*

Disallow: /?page_id=*

Disallow: /?cat=*

Disallow: /?tag=*

# Include the sitemap (location needs to be replaced with your own)

Sitemap: http://yourdomain.com/sitemap.xmlDeși toate directivele sunt însoțite de comentarii, haideți să aprofundăm concluziile.

- Roboții nu vor indexa fișierele și directoarele sensibile.

- În același timp, roboților li se permite accesul la paginile și resursele principale ale site-ului.

- interdicția este stabilită pentru indexarea versiunilor vechi ale postărilor și a interogărilor parametrizate pentru a preveni duplicarea conținutului.

- Locația hărții site-ului este indicată pentru o indexare îmbunătățită.

Astfel, am luat în considerare un exemplu general de configurație gata, în care unele fișiere și căi sensibile sunt ascunse de indexare, dar directoarele principale sunt accesibile.

Spre deosebire de multe CMS populare sau site-uri scrise personalizat, WordPress are mai multe plugin-uri care facilitează crearea și gestionarea fișierului robots.txt. Una dintre soluțiile populare în acest scop este Yoast SEO.

Pentru a-l instala, trebuie să:

- Accesați panoul de administrare WordPress.

- În secțiunea „Plugin-uri”, selectați „Adăugați nou”.

- Găsiți pluginul „Yoast SEO” și instalați-l.

- Activați pluginul.

Pentru a edita fișierul robots.txt, trebuie să:

- Accesați secțiunea „SEO” din meniul lateral al panoului de administrare și selectați „General”.

- Accesați fila „Instrumente”.

- Faceți clic pe „Fișiere”. Aici veți vedea diferite fișiere, inclusiv robots.txt.

- Introduceți regulile de indexare necesare conform cerințelor dvs.

- După ce ați făcut modificări fișierului, faceți clic pe butonul „Salvați modificările în robots.txt”.

Rețineți că fiecare setare de fișier robots.txt pentru WordPress este unică și depinde de nevoile și caracteristicile specifice ale site-ului. Nu există un șablon universal care să se potrivească tuturor resurselor fără excepție. Cu toate acestea, acest exemplu și utilizarea pluginurilor pot simplifica semnificativ sarcina.

Setarea manuală a Robots.txt

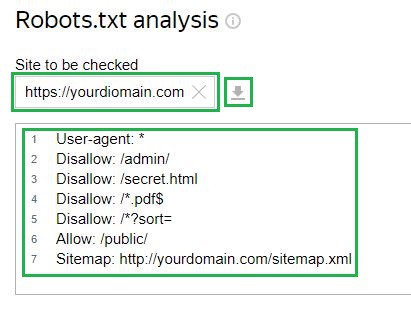

În mod similar, puteți configura configurația fișierului chiar și în absența unui CMS pregătit pentru site. De asemenea, utilizatorul trebuie să încarce fișierul robots.txt în directorul rădăcină al site-ului și să specifice regulile necesare. Iată unul dintre exemple, în care sunt indicate toate directivele disponibile:

User-agent: *

Disallow: /admin/ # Prohibit access to the administrative panel

Disallow: /secret.html # Prohibit access to a specific file

Disallow: /*.pdf$ # Prohibit indexing of certain file types

Disallow: /*?sort= # Prohibit indexing of certain URL parameters

Allow: /public/ # Allow access to public pages

Sitemap: http://yourdomain.com/sitemap.xml # Include the sitemapCum să verificați fișierul Robots.txt

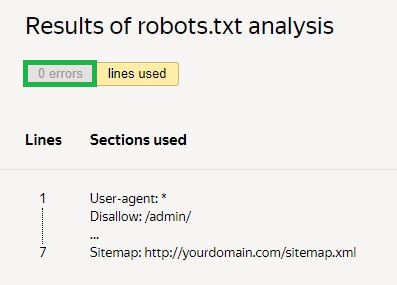

Ca instrument auxiliar atunci când verificați fișierul robots.txt pentru erori, se recomandă utilizarea serviciilor online.

Luați în considerare exemplul Webmaster Yandex serviciu. Pentru a verifica, trebuie să inserați un link către site-ul dvs. în câmpul corespunzător dacă fișierul este deja încărcat pe server. După aceea, instrumentul în sine va încărca configurația fișierului. Există, de asemenea, o opțiune pentru a introduce manual configurația:

În continuare, trebuie să solicitați o verificare și să așteptați rezultatele:

În exemplul dat, nu există erori. Dacă există, serviciul va afișa zonele problematice și modalitățile de a le remedia.

Concluzie

Pe scurt, am subliniat cât de important este fișierul robots.txt pentru controlul traficului de pe site. Am oferit sfaturi despre cum să o configurați corect pentru a gestiona modul în care motoarele de căutare indexează paginile. În plus, am analizat și exemple despre cum să utilizați corect acest fișier și am dat instrucțiuni despre cum să verificați dacă toate setările funcționează corect.